AI時代のガバナンス:リスク管理と活用推進の両立

AIガバナンスの全体像を、技術・法規制・倫理・事業の4つのリスクカテゴリと、ルール・仕組み・文化の3層フレームワークで整理。事業会社でのBCP経験がAIリスク管理に通じる知見をもとに、経営者が取るべき具体的アクションを解説します。

AI活用を「推進する」と同時に「リスクを管理する」。この二つは矛盾するように見えて、実は同じコインの裏表です。

生成AIの導入が加速する中、「とにかく使え」と号令をかける企業がある一方、「リスクが怖いから禁止」と全面規制をかける企業もある。どちらも極端です。必要なのは、「使いながら守る」ための仕組み ― すなわちAIガバナンスです。

私は事業会社時代にBCP(事業継続計画)の策定に関わった経験があります。当時学んだのは、「リスク管理とは、リスクをゼロにすることではなく、許容可能なレベルに管理すること」だということです。AIガバナンスもまったく同じ考え方です。

各国のAI規制動向 ― 経営者が知っておくべき最低限

EU AI Act

2024年に成立したEU AI Actは、AIを「リスクレベル」で分類する世界初の包括的なAI規制法です。ハイリスクAI(採用AI、信用評価AI等)には厳格な透明性義務が課され、「許容できないリスク」のAI(ソーシャルスコアリング等)は禁止。EU域内でビジネスを行う企業は対応が必要です。

日本のAIガイドライン

日本は法規制ではなく「ソフトロー」アプローチを取っています。経済産業省の「AI事業者ガイドライン」(2024年)が中心的な指針です。法的拘束力はありませんが、企業がAIを活用する際の「行動規範」として機能しています。グローバルに事業展開する企業は、EUの法規制と日本のガイドラインの両方を視野に入れる必要があります。

企業が押さえるべきAIリスクの全体像

AIのリスクを「技術」「法規制」「倫理」「事業」の4カテゴリで整理します。一つのカテゴリだけ見ていると、別のカテゴリのリスクを見落とします。

技術的リスク

- ハルシネーション: AIが事実に基づかない情報を生成する

- バイアス: 学習データの偏りが、差別的な出力につながる

- ブラックボックス化: AIの判断理由を人間が説明できない

法的・規制リスク

- EU AI Act等の規制への非対応: グローバル企業は特に注意が必要

- 個人情報保護: AIの入力データに個人情報が含まれるリスク

- 著作権侵害: AIが生成したコンテンツの権利関係の不明確さ

倫理的リスク

- 差別・偏見の助長: 採用AIが特定の属性を不当に排除する等

- 雇用への影響: AIによる業務代替が社員の不安・離職を招く

- プライバシー侵害: 顧客データのAI学習への利用

事業リスク

- ベンダーロックイン: 特定のAIプラットフォームへの依存

- コスト肥大化: AIの運用コストが想定を超えて膨らむ

- 競争優位の喪失: AI活用で出遅れることによる市場地位の低下

図解1: AIリスクマップ ― 技術・法規制・倫理・事業の4カテゴリで構造的に把握する

図解1: AIリスクマップ ― 技術・法規制・倫理・事業の4カテゴリで構造的に把握する

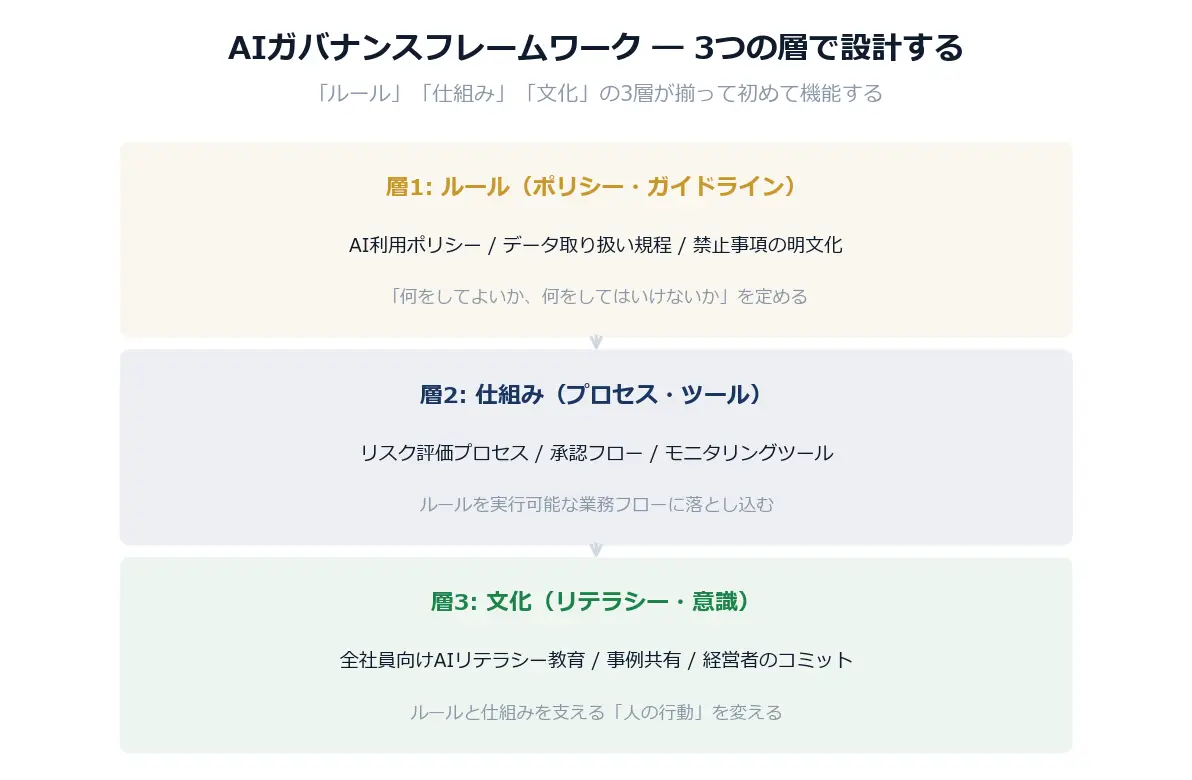

AIガバナンスフレームワークの設計

AIリスクを管理するためのフレームワークを、「ルール」「仕組み」「文化」の3層で設計します。

層1: ルール(ポリシー・ガイドライン)

最初に必要なのは「AI利用ポリシー」の策定です。「何をAIに入力してよいか」「AIの出力をどうレビューするか」「どのAIサービスの利用を認めるか」を明文化する。ルールがない状態で「自由に使え」と言うのは、交通ルールなしに「自由に運転しろ」と言うのと同じです。

層2: 仕組み(プロセス・ツール)

ルールを「絵に描いた餅」にしないために、業務プロセスに組み込む仕組みが必要です。新しいAI活用を始める前のリスク評価プロセス。AIが生成した成果物の承認フロー。AIの利用状況を定期的にモニタリングする仕組み。これらを業務フローとして標準化します。

層3: 文化(リテラシー・意識)

ルールと仕組みがあっても、それを守る「人の意識」が伴わなければ機能しません。全社員向けのAIリテラシー教育。AI活用の成功事例と失敗事例の社内共有。そして何より、経営者自身がAIガバナンスにコミットする姿勢。「ルールは守るもの」ではなく「自分たちを守るもの」という認識が組織に根づいたとき、ガバナンスは初めて機能します。

BCP経験がAIリスク管理に通じる

事業会社時代、BCP(事業継続計画)策定に携わりました。地震や停電など、起きてほしくないが備えなければならないリスクに対して、「発生確率」と「影響度」のマトリクスでリスクを評価し、優先順位をつけて対策を設計する。AIガバナンスの考え方は、これと本質的に同じです。

AIのリスクも、「起きる確率」と「起きた場合の影響」で評価する。すべてのリスクを同じ重さで対処するのではなく、影響度の高いリスクに集中的にリソースを投じる。BCPで学んだこの原則が、AIガバナンスの設計において非常に役立っています。

図解2: AIガバナンスフレームワーク ― 「ルール」「仕組み」「文化」の3層が揃って初めて機能する

図解2: AIガバナンスフレームワーク ― 「ルール」「仕組み」「文化」の3層が揃って初めて機能する

経営者が取るべきアクション

AIガバナンスは「完璧なルールを作ること」ではなく、「まず始めて、運用しながら磨いていくこと」が大切です。

- AI利用ポリシーを策定する: 完璧でなくてよい。「機密情報はAIに入力しない」「AIの出力は必ず人間がレビューする」の2点だけでも、まず明文化する

- リスク評価のプロセスを1つ作る: 新しいAIツールを導入する前に「どんなリスクがあるか」をチェックするシートを1枚作る

- 全社向けにAIリテラシー研修を実施する: 「何ができて、何ができないか」「何に注意すべきか」を全社員が理解している状態を作る

ガバナンスは「ブレーキ」ではなく「安全装置」です。安全装置があるからこそ、安心してアクセルを踏める。AI活用を加速させるために、ガバナンスを整える。この順番を間違えないことが重要です。

まとめ ― 「使いながら守る」がAI時代の経営

AIガバナンスの本質は「AIを禁止すること」ではなく、「AIを安全に活用するための仕組みを作ること」です。技術・法規制・倫理・事業の4つのリスクカテゴリを構造的に把握し、ルール・仕組み・文化の3層でガバナンスを設計する。

リスクをゼロにすることは不可能です。しかし、許容可能なレベルに管理することはできる。そのために必要なのは、完璧なルールではなく、「走りながら修正し続ける」姿勢です。DXロードマップと同じく、AIガバナンスもまた「完璧を待たずに始める」ことが最も重要です。

関連記事

著者: Sam(柴山 治)

株式会社YOHACK 代表 | 経営コンサルタント | 著者・監修者

SIer → コンサルティングファーム → 事業会社 → ファーム執行役員 → 創業。

DXの「依頼する側」と「実行する側」の両方を経験した立場から、

経営者に伴走するコンサルティングを行っています。

ファンド投資先企業でCIO/CDOを歴任。

経営者向け月刊誌にてDX連載を監修。

母校の大学院で客員講師。

日米双方でMBA取得。

著書『日本型デジタル戦略』(クロスメディア・パブリッシング)等。

▼ YOHACK公式サイト

https://www.yohack.io

▼ DX推進でお悩みの方はお気軽にご相談ください

https://www.yohack.io/contact